- Nvidias H100-Grafikkarten werden bei eBay für über 40.000 US-Dollar verkauft.

- Ausgefeilte Chips sind nach wie vor unerlässlich für das Training und den Einsatz von KI-Programmen.

- John Carmack, ein 3D-Gaming-Pionier und ehemaliger Beratungsleiter von Meta Technology, notierte die Preisgestaltung auf Twitter.

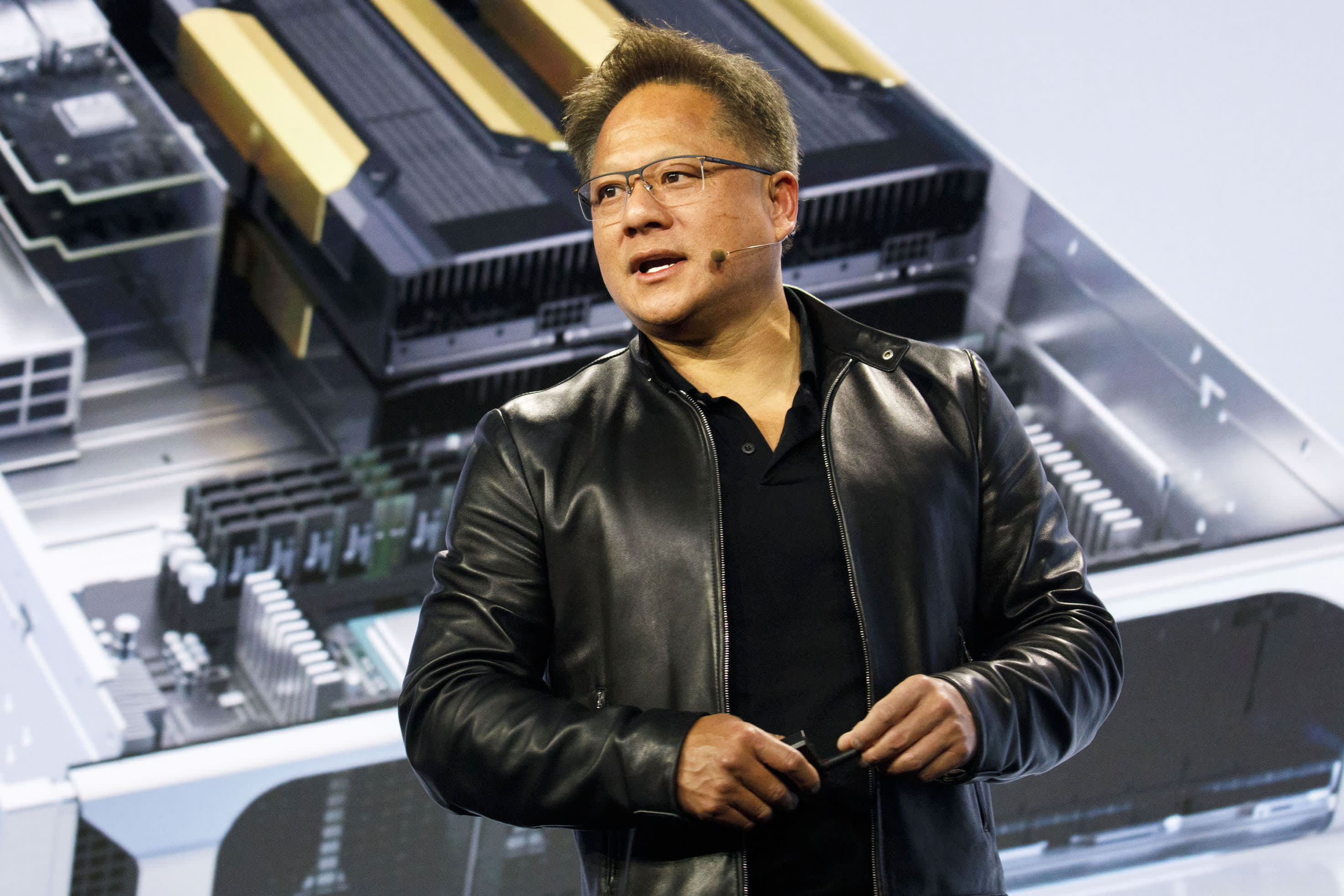

Jen-Hsun Huang, Präsident und CEO von Nvidia Corp. , kündigt die EGX Edge Supercomputing-Plattform während der Veranstaltung des Unternehmens auf dem Mobile World Congress Americas in Los Angeles, Kalifornien, am 21. Oktober 2019 an.

Patrick T Fallon | Blumenberg | Getty Images

Die fortschrittlichsten Grafikkarten von Nvidia werden bei eBay für mehr als 40.000 US-Dollar verkauft, da die zum Trainieren und Bereitstellen von KI-Programmen erforderlichen Chips sehr gefragt sind.

Die Preise für Nvidias H100-Prozessoren wurden vom 3D-Gaming-Pionier und ehemaligen Head of Meta Consulting Technology John Carmack notiert. auf Twitter. Am Freitag wurden bei eBay nicht weniger als acht H100 mit Preisen zwischen 39.995 $ und knapp 46.000 $ gelistet. Angeboten von einigen Händlern in der Vergangenheit für Ungefähr 36.000 Dollar.

Der im vergangenen Jahr angekündigte H100 ist Nvidias neuester KI-Flaggschiff-Chip, der Nachfolger des A100, dem rund 10.000 US-Dollar teuren Chip, der als „Arbeitstier“ für KI-Anwendungen bezeichnet wird.

Entwickler verwenden das H100, um sogenannte Large Language Models (LLMs) zu erstellen, die das Herzstück von KI-Anwendungen wie ChatGPT von OpenAI bilden. Der Betrieb dieser Systeme ist teuer und erfordert leistungsstarke Computer, um Daten tage- oder wochenlang im Terabyte-Bereich zu verschieben. Es setzt auch auf massive Rechenleistung, damit das KI-Modell Texte, Bilder oder Vorhersagen generieren kann.

Das Training von KI-Modellen, insbesondere von großen Modellen wie GPT, erfordert die Zusammenarbeit von Hunderten von High-End-Nvidia-GPUs.

Microsoft hat Hunderte Millionen Dollar für Zehntausende von Nvidia A100-Chips ausgegeben, um zu helfen ChatGPT-Build. Nvidia kontrolliert den überwiegenden Teil des Marktes für KI-Chips.

Nvidia baut auch einen Supercomputer namens DGX mit acht zusammenarbeitenden GPUs. Anfang dieses Jahres kündigte das Unternehmen neue Dienste an, die es Unternehmen ermöglichen, den Zugang zu DGX-Computern für sie zu leasen 37.000 Dollar im Monat. Zu diesem Preis wird das System die älteren A100-Prozessoren von Nvidia verwenden.

Laut Nvidia ist der H100 der erste Chip, der für die spezifische KI-Architektur optimiert wurde, die viele der jüngsten Fortschritte in der KI, genannt Transformers, untermauert. Branchenexperten sagen, dass leistungsfähigere Chips benötigt werden, um Modelle zu bauen, die größer und datenhungriger sind als die derzeit verfügbaren.

Er schaut: Googles Chipherstellung zielt auf Nvidias generative KI ab

„Professioneller Internet-Junkie. Bacon-Fanatiker. Freundlicher Gamer. Bierfreak. Analyst. Twitter-Fan.“

More Stories

Apple bestätigt, dass weitreichende iPhone-Änderungen Millionen von iPads erreichen werden

Helldivers 2 wurde in 170 Ländern ohne Zugang zum PSN von Steam entfernt, da Valve seine Richtlinie ignoriert, Spielern mit mehr als 100 Stunden Rückerstattungen zu gewähren

Helldivers 2 hat seit der Ankündigung, dass Spieler Steam mit einem PSN-Konto verknüpfen müssen, 100.000 negative Bewertungen erhalten